KAIST(총장 신성철)가 인공지능(AI)을 활용해 비디오 영상 프레임을 초당 30장에서 60장으로 늘려주는 기술을 개발했다.

김문철 KAIST 전기 및 전자공학부 교수팀은 기존 영상 고프레임화 기술을 개선해 'AI 딥러닝 기반 고프레임율 비디오 생성 기술'을 개발했다고 30일 밝혔다.

비디오 영상은 다수의 정지 화면을 연속해 보는 것이다. 프레임율이 높을 수록 움직임이 끊김없이 부드럽다. 저해상도 콘텐츠는 초당 30프레임 영상이 주를 이루지만, 4K UHD 비디오는 초당 60프레임이 표준이다. 해상도가 증가할수록 사람이 체감하는 프레임 변화가 커진다.

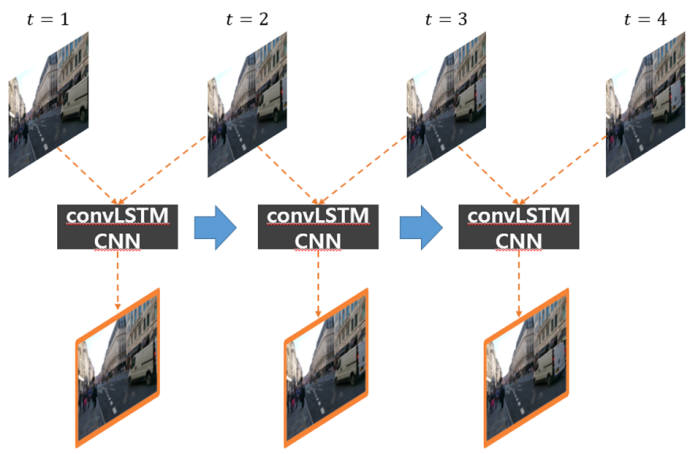

고프레임화 기술로는 원본 영상의 움직임을 예측해 새로운 프레임을 생성하는 '보간' 기술이 나왔다. 하지만 아직은 기술 성숙도가 낮아 화질이 떨어진다. '콘볼루션신경망(CNN)'을 이용했는데, 예측 정확도가 낮다.

김 교수팀은 기존 CNN 모델에 AI 기술을 더해 시간 변화에 따른 영상 속 움직임 변화를 정확하게 학습하도록 하는 '순환신경망(RNN)' 구조를 결합한 'convLSTM-CNN' 모델을 개발해 문제를 해결했다.

UHD 방송·IPTV·스트리밍 사업자 등이 이 기술을 활용하면 고화질 콘텐츠를 대거 확보할 수 있다. TV 및 빔프로젝터, 헤드마운티드디스플레이(HMD)에도 적용할 수 있다.

김문철 교수는 “UHD 방송 활성화를 위해서는 공간 해상도뿐만 아니라 프레임율을 높이는 기술도 필요하다”며 “KAIST의 AI 기반 영상 품질 향상 기술이 관련 산업 분야에 넓게 쓰일 전기를 마련했다”고 말했다.

대전=김영준기자 kyj85@etnews.com