“최근 인공지능(AI)은 텍스트만 다루는 초거대언어모델(LLM)을 넘어 이미지와 영상, 음악과 음성까지 동시에 이해하고 생성하는 '멀티모달' 모델로 진화하고 있습니다. 또 스스로 이해하고 판단하는 '에이전틱 AI'로 발전 중입니다. 방대한 양의 데이터를 가까이 두고 빠르게 처리할 수 있는 기술이 매우 중요해지고 있어 앞으로 AI 컴퓨팅은 메모리가 중심이 될 것입니다.”

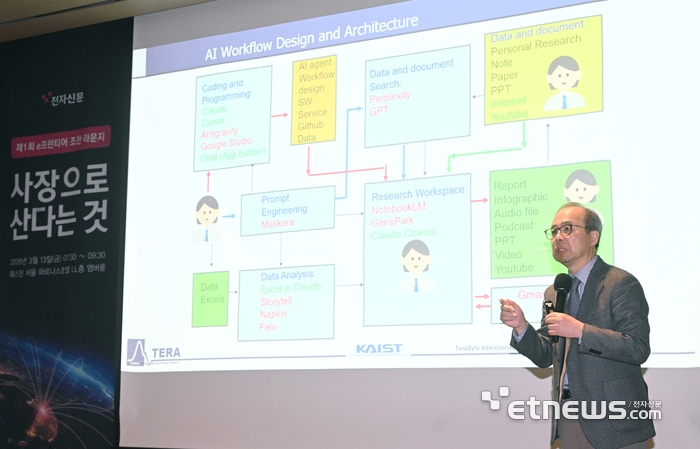

김정호 KAIST 전기 및 전자공학부 교수는 미래 AI 성능은 메모리 반도체가 좌우할 것이라고 강조했다. 13일 전자신문이 주최한 e프런티어 조찬 행사에 연사로 나서 '메모리 센트릭' 시대 도래를 전망했다.

김 교수는 AI 필수 반도체로 꼽히는 고대역폭메모리(HBM)의 기본 구조와 개념을 창안한 세계적 석학이다. 지난 20년 동안 HBM 관련 설계 기술을 주도해 왔으며 2010년부터 HBM 상용화 설계에 직접 참여하고 있다.

그는 “PC 시대에는 중앙처리장치(CPU), 스마트폰 시대에는 저전력이 핵심이었다면 AI 시대에선 메모리가 핵심”이라며 “HBM이 속도를 결정할 것이고,용량은 HBF가 담당하게 될 것”이라고 말했다.

HBF는 비휘발성 메모리인 낸드 플래시를 수직으로 쌓아 용량을 극대화한 메모리다. 여러 개의 D램을 수직으로 쌓은 HBM과 개념이 유사하다.

HBF의 최대 장점은 '대용량'이다. 데이터처리 속도를 극대화한 HBM보다 10배까지 용량 확장이 가능하고 가격은 저렴해 HBM의 비용과 용량 문제를 해결할 메모리 기술로 꼽힌다.

김 교수는 현재 GPU에 HBM 탑재가 필수적인 것처럼 HBF 역시 핵심 AI 메모리로 부상할 것이라고 강조했다. 그러면서 오는 2038년부터는 HBF 수요가 HBM을 넘어설 것이라고 내다봤다.

그는 “CPU·GPU·메모리가 하나의 베이스 다이 위에서 유기적으로 결합하는 메모리 중심 컴퓨팅(MCC) 아키텍처가 완성되면 필요한 HBF 물량은 더욱 늘어날 것”이라고 말했다.

AI 에이전트 서비스에서는 사용자의 과거 답변 등 기존 데이터를 기억해 대화의 맥락을 이어가는 것이 중요하다. 여기에 필요한 것이 장기 기억 역할을 하는 '키밸류'(KV) 캐시 메모리다.

현재 구조에서는 GPU에 탑재된 HBM이 이 역할을 맡고 있다. 그러나 추론 영역 확대로 HBM의 본래 목적인 연산에 써야 할 용량이 부족해지면서, 메모리 병목현상이 발생하는 문제가 나타나고 있다.

그는 “HBM이 방 안의 서고처럼 가까이 있어 필요한 정보를 빠르게 꺼낼 수 있다면, HBF는 도서관의 거대한 서가와 같다”며 “미래 AI 칩은 속도를 담당하는 HBM과 용량을 담당하는 HBF가 공존하는 형태가 될 것”이라고 말했다.

윤건일 기자 benyun@etnews.com