엔비디아가 인공지능(AI) 추론 전용 칩을 공개하면서 AI 메모리 저변이 넓어졌다. 기존 고대역폭메모리(HBM)가 주도했던 시장에서 추론 칩에 탑재되는 S램까지 확장되면서, AI 메모리 공급망도 판도 변화가 예상된다.

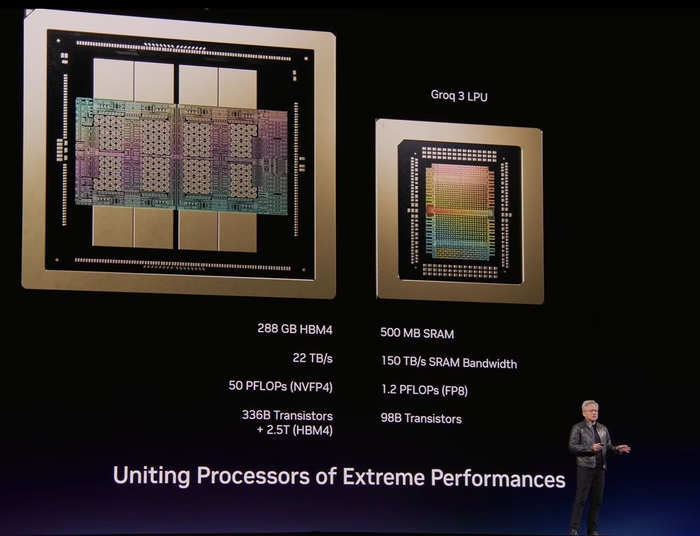

업계에 따르면, 16일(미국 현지시간) 엔비디아 GTC 2026에서 공개된 AI 추론 칩 '그록3 LPU'는 S램을 탑재했다. AI 연산에 주로 쓰였던 HBM 대신 핵심 메모리 역할을 담당한다.

S램은 전원이 공급되는 중에는 데이터를 유지하고 접근이 매우 빠른 메모리다. 보통 중앙처리장치(CPU) 내부 캐시 메모리로 활용된다. 속도가 D램보다 매우 빠르다는 장점 때문에 엔비디아 추론 칩에 적용된 것으로 풀이된다.

S램은 비트당 트랜지스터 개수가 D램보다 많아 집적도가 낮다. 특히 용량을 키우는게 어렵다. 그록3 LPU에 탑재되는 S램은 150TB/s의 높은 대역폭(전송 속도)을 확보했다. 그러나 용량은 500MB 수준으로 낮다.

엔비디아가 그록3 LPU를 차세대 AI 플랫폼 '베라 루빈'에 통합한 것도 이 때문으로 분석된다. 빠른 AI 추론이 가능하지만 메모리 용량 한계가 있는 만큼, 베라 루빈 플랫폼을 통해서 이를 해결하려는 시도다. 베라 루빈의 HBM과 통합 운용하는 방식이다.

지금은 S램이 반도체 설계자산(IP) 형태로 AI 추론칩에 적용된다. 업계에서는 여기서 한발 더 나아가 S램이 단독 칩으로 적용될 가능성도 제기하고 있다. HBM처럼 프로세서(LPU) 외부에서 데이터를 처리하는 방식이 예상된다. D램을 쌓아 HBM을 구현하는 것처럼 S램 적층 구조도 논의되고 있다.

이 경우 S램을 따로 제조하는 새로운 공급망이 구축될 수 있다. S램은 D램 제조와 달리 파운드리 영역에 가까워 수나노미터(㎚) 공정 역량이 필요하다. 10㎚ 대인 D램과는 다른 공급망이 형성된다는 의미다.

현재 수㎚ 급 반도체 제조가 가능한 곳은 삼성전자·TSMC·인텔 정도다. 당장은 엔비디아 AI 추론 칩을 양산하는 삼성전자가 유리한 고지를 점했지만, 향후 S램 시장이 확대될 경우 각축전이 불가피할 것으로 관측된다.

업계 관계자는 “업계에서는 이미 차세대 트랜지스터 구조인 게이트올어라운드(GAA)로 S램을 개발하고 있다”며 “초미세 공정 역량을 확보한 반도체 제조사가 S램 시장 주도권을 쥘 수 있을 것”이라고 밝혔다.

권동준 기자 djkwon@etnews.com