인텔이 개방형 인공지능(AI) 생태계 조성에 속도를 높인다. 오픈소스 소프트웨어(SW)와 표준 하드웨어(HW)를 앞세워, 보다 많은 개발자·기업·연구기관이 참여하는 '협업형 AI 생태계'를 구축할 계획이다. 엔비디아가 주도하는 AI 시장에서 탈피해 새판을 짜려는 포석이다.

업계에 따르면, 인텔은 3분기 차세대 AI 반도체 칩 '가우디 3' 공식 출시를 앞두고 관련 SW·HW 생태계 정비에 박차를 가하고 있다. 높은 엔비디아 AI 반도체 의존도를 낮추려는 시도로, 인텔을 비롯한 다양한 AI 반도체 칩 제조사의 '경쟁 가능한 시장'으로 탈바꿈하려는 전략으로 풀이된다.

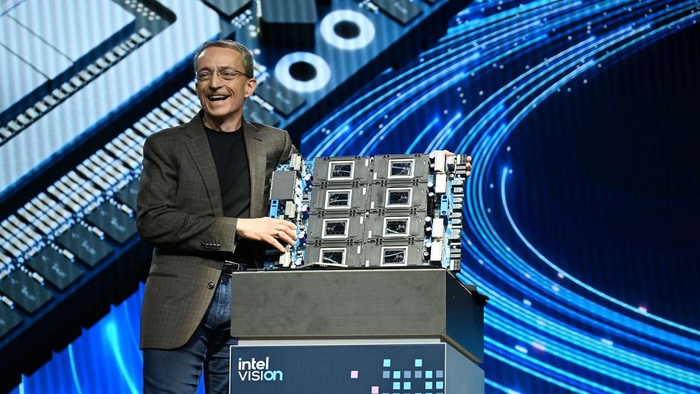

AI 구현을 위한 SW 개발도구와 HW 네트워킹 기술이 대표적이다. 인텔은 자사 AI 반도체 칩 가우디 시리즈를 '라마(Llama)'에 최적화하고 검증을 진행하고 있다. 지난달 개최된 '인텔 비전 2024'에서도 가우디를 포함한 자사 AI 반도체 칩의 성능을 라마에서 평가, 엔비디아 주력 AI 칩(H100) 대비 우위를 확보했다고 강조했다.

라마는 메타에서 개발한 오픈소스 대규모언어모델(LLM)이다. 인텔이 비전 2024에서 라마를 전면에 내세운 건 자사 AI 반도체 칩 저변 확대 방법론으로 오픈소스를 낙점했다는 것으로 풀이된다.

또 AI를 위한 개방형 SW 개발 도구에도 적극 투자한다. 현재 AI SW는 엔비디아 쿠다가 주력인데, 엔비디아 그래픽처리장치(GPU)에서만 구동되기 때문에 폐쇄적이란 비판을 받아왔다. 인텔의 개방형 SW 투자는 이같은 독점 구조에서 탈피하려는 것이다.

이를 위해 인텔은 UXL 재단을 통해 쿠다 플랫폼에 대응하는 오픈소스 프로젝트를 추진 중이다. UXL 재단은 폐쇄적 엔비디아 쿠다에 대항, 여러 종류의 AI 칩을 지원하는 SW와 툴을 개발하기 위해서 인텔·퀄컴·구글·삼성 등 주도로 지난해 9월 설립됐다.

인텔이 네이버 및 KAIST와 손을 맞잡은 것도 같은 맥락이다. 인텔은 비전 2024에서 네이버와 가우디 기반 AI SW 생태계를 구축한다고 밝힌 바 있다. 여기에 한발 더 나아가 KAIST와도 협력, 'NIK(네이버·인텔·KAIST) AI 공동 연구센터'를 설립하기로 했다.

KAIST에 설치될 연구센터는 가우디를 위한 플랫폼 생태계 공동 구축이 목표다. 자연어 처리·컴퓨터 비전·머신 러닝 등 AI 분야 오픈소스 SW를 개발하는 것이 핵심이다. 엔비디아 AI 칩 중심 개발 생태계 무게 중심을 가우디로, 더 나아가 개방형으로 바꾸려는 시도로 풀이된다.

AI 인프라 구축에 필수인 네트워킹 기술에서도 인텔 행보가 주목된다. 대규모 AI 모델을 처리하려면 AI 반도체 칩이나 서버 간 연결 체계인 AI 네트워킹이 필수인데, 인텔은 산업 표준인 이더넷으로 채택했다. 사실상 독점 기술인 인피니밴드를 전면에 내세운 엔비디아와 대비된다. 이번 비전 2024에서도 AI 인프라에 최적화한 이더넷 솔루션을 소개했다.

인텔 관계자는 “향후 대학과 오픈소스 커뮤니티, 협력사와 AI SW와 HW 협력을 확대해 나갈 것”이라며 “개방형 AI 생태계 투자에 집중해 가우디 중심 AI 시장 저변을 확장할 계획”이라고 밝혔다.

권동준 기자 djkwon@etnews.com