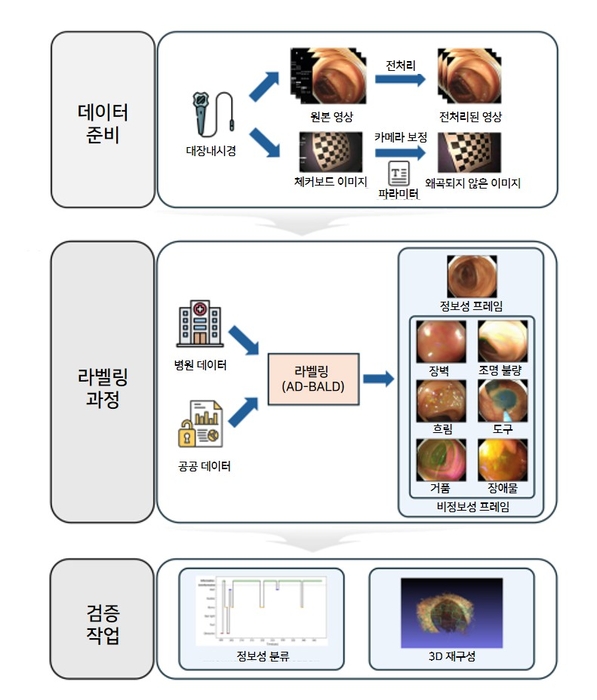

서울대병원 연구팀이 대장내시경 영상에서 진단 가치가 높은 프레임을 효율적으로 선별하는 알고리즘을 개발했다. 이를 기반으로 16만 프레임 규모 데이터셋을 구축함에 따라 향후 대장내시경 인공지능(AI) 연구 효율성을 높이는 기반이 될 전망이다.

서울대병원 영상의학과 이동헌 교수와 강남센터 소화기내과 진은효 교수 연구팀은 소량의 데이터셋만으로도 정보성 대장내시경 영상을 효율적으로 분류할 수 있는 능동학습 기반 알고리즘 'AD-BALD'를 개발했다고 23일 밝혔다.

또 이를 활용해 서울대병원 강남센터·충남대병원의 실제 임상 데이터와 글로벌 공공 데이터를 통합한 16만 프레임 규모의 데이터셋 '인포콜론(InfoColon)'을 구축했다.

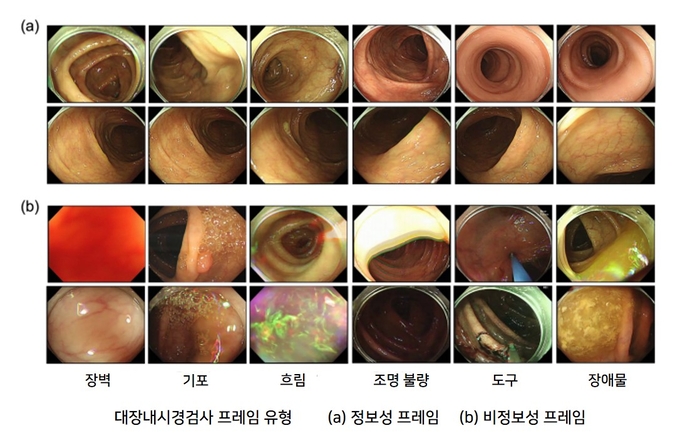

대장내시경은 검사 과정에서 화면 흐림이나 거품 등으로 영상 품질이 저하되는 문제가 있다. 진단 가치가 낮은 '비정보성 프레임'은 AI 모델의 학습 효율을 떨어뜨리고 실시간 진단 보조 시스템의 정확도를 저해하는 주요 원인으로 지목돼 왔다.

연구팀이 개발한 알고리즘은 AI가 스스로 분류하기 모호한 내시경 영상을 골라 전문가에게 확인을 요청하는 방식이다. 연구팀은 영상을 진단 가치가 높은 '정보성 프레임'과 '비정보성 프레임' 6종(장벽, 거품, 흐림, 조명 불량, 도구, 장애물)으로 구분했다. 전체 데이터의 약 9%(1만2663프레임)만 직접 라벨링하고도 알고리즘을 활용해 16만 프레임 규모 데이터셋을 완성했다.

데이터셋 구축에 활용된 알고리즘은 분류 정확도 지표인 AUROC에서 최대 0.975를 기록했다. 이는 제한된 인력과 비용으로도 고품질 의료 데이터를 생성할 수 있음을 의미한다.

연구팀은 알고리즘이 선별한 정보성 프레임을 활용해 대장 내부 구조를 3차원 점구름 형태로 재구성해 임상·공학적 유용성을 입증했다. 향후 시술 중 병변을 놓치지 않도록 돕는 '내시경 내비게이션' 기술로의 확장 가능성을 제시했다.

이동헌 교수는 “인포콜론은 비정보성 프레임 문제 해결을 위한 표준화된 학습 지침서”라며 “AD-BALD를 함께 활용하면 방대한 영상을 효율적으로 가공할 수 있어 차세대 내시경 AI 연구에 실질적인 도움이 될 것”이라고 말했다.

배옥진 기자 withok@etnews.com