국내 연구진이 인공지능(AI) 딥러닝 모델을 처리에 필수인 기계학습 시스템 성능을 끌어올리는 성과를 거뒀다.

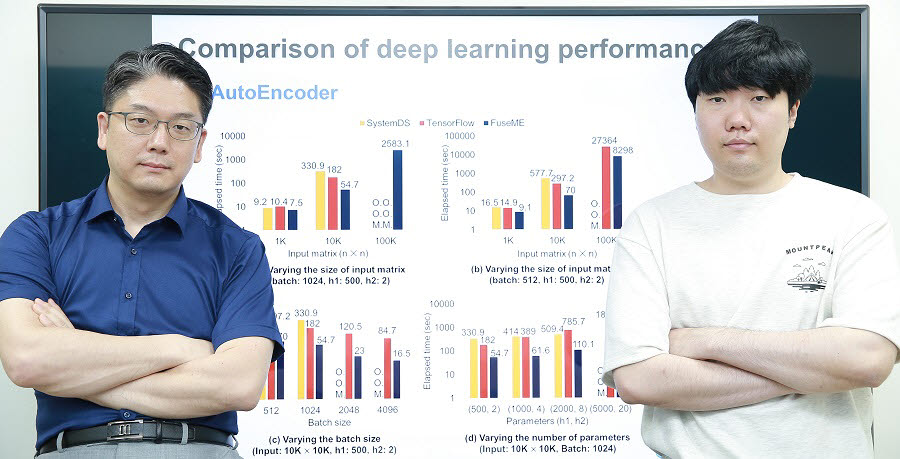

한국과학기술원(KAIST)은 김민수 전산학부 교수팀이 기계학습 시스템 성능을 대폭 높일 수 있는 세계 최고 수준 행렬 연산자 융합 기술(FuseME)을 개발했다고 20일 밝혔다.

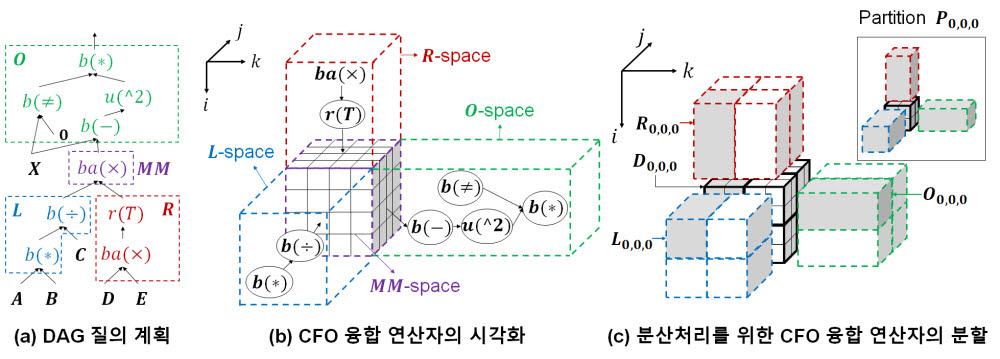

보통 딥러닝 모델은 행렬 곱셈, 행렬 합, 행렬 집계 등 '행렬 연산자'로 구성된 '방향성 비순환 그래프(DAG) 질의 계획'으로 표현된다. 수많은 컴퓨터로 구성된 클러스터로 처리한다. 모델과 데이터 규모가 커지면 처리에 실패하거나 시간이 오래 걸린다.

연구팀은 DAG 질의 계획의 행렬 연산자로부터 생성되는 중간 데이터에 주목했다. 이들을 메모리에 저장하거나 다른 컴퓨터로 전송하는 것이 문제 원인임에 착안, 행렬 연산자들을 하나의 연산자로 융합하는 기술로 문제를 해결했다. 이를 통해 중간 데이터 저장이나 전송이 이뤄지지 않게 했다.

지금까지 기계학습 시스템들은 낮은 수준의 연산자 융합 기술만을 사용해 성능이 별로 개선되지 않거나, 처리 실패 등을 겪었다. 연구팀의 FuseME 기술은 DAG 질의 계획에서 어떤 연산자끼리 융합하는 것이 더 유리한지 판별해 그룹으로 묶고 클러스터 사양, 네트워크 통신 속도, 입력 데이터 크기 등을 고려한다. 이론상 최적 성능을 내는 'CFO 연산자'를 융합한다.

FuseME 기술을 구글 텐서플로우나 IBM 시스템DS와 비교 평가한 결과, 딥러닝 모델 처리 속도는 최대 8.8배 향상되는 것으로 나타났다. 기존 처리할 수 없는 더 큰 규모 모델 및 데이터 처리에도 성공했다. 또 CFO 융합 연산자는 종래 최고 수준 융합 연산자와 비교해 처리 속도를 최대 238배 향상시키고, 네트워크 통신 비용을 최대 64배 감소시켰다.

연구팀은 이미 지난 2019년에 초대규모 행렬 곱 연산에 대해 종래 세계 최고 기술이었던 IBM 시스템ML, 슈퍼컴퓨팅 분야 스칼라팩(ScaLAPACK) 대비 성능과 처리 규모를 훨씬 향상시킨 DistME 기술을 개발한 바 있다. 이번 FuseME 기술은 연산자 융합이 가능하도록 DistME를 한층 더 발전시킨 것으로, 해당 분야를 세계 최고 수준 기술력을 바탕으로 지속적으로 선도하는 쾌거를 보여줬다.

교신저자 김민수 교수는 “개발 기술은 딥러닝 등 기계학습 모델 처리 규모와 성능을 획기적으로 높일 수 있어 산업적 측면에서 파급 효과가 매우 클 것으로 기대한다”고 말했다.

이번 연구에는 김 교수 제자이자 그래파이(GraphAI) 스타트업 공동 창업자인 한동형 박사가 제1 저자로 참여했다. 지난 16일 미국 필라델피아에서 열린 데이터베이스 분야 최고 국제학술대회 'ACM SIGMOD'에서 연구 내용을 발표했다.

한편, 이번 연구는 한국연구재단 선도연구센터 사업 및 중견연구자 지원사업, 과기정통부 정보통신기획평가원(IITP) 소프트웨어(SW)스타랩 사업 지원을 받아 수행됐다.

김영준기자 kyj85@etnews.com