서울디지털재단이 지방자치단체 최초로 서울시 생성형 인공지능(AI) 윤리 가이드라인을 발표했다.

디지털 권리장전을 제정하고 분야별 윤리 가이드라인을 마련한다는 정부 정책 기조에 발맞추려는 노력의 일환이다.

서울디지털재단은 산·학·연 전문가 의견을 수차례 수렴, 3대 기본원칙을 담은 윤리 가이드라인 추진방향과 9대 핵심요건을 도출했다.

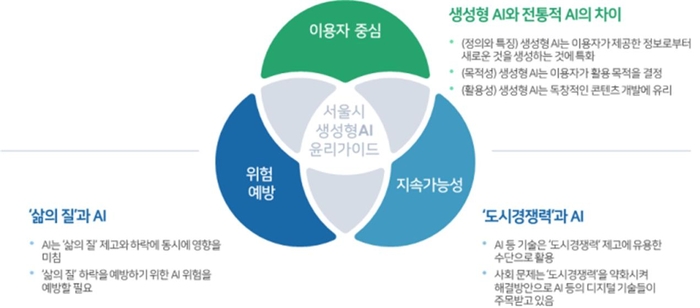

윤리 가이드라인은 '이용자 중심, 위험예방, 지속가능성'을 3대 기본원칙으로 선정했다.

이를 바탕으로 △이용자의 검증 역량 △책임성 △데이터 권리와 책임 △사용가능성 확보 △AI 학습데이터 안전성 △AI 윤리 소양 △공공성 △생태적 지속가능성 △보안성을 9대 핵심요건으로 제시했다.

가이드라인은 이용자와 운영자, 개발자 등 이해관계자가 9대 핵심요건을 준수하기 위해 알아야 할 핵심요건별 위험유형, 실제사례와 함께 배경과 주의사항을 담았다.

일례로 AI 학습데이터 안전성 항목에서 개발자는 타인의 저작권을 침해하지 않는 범위에서 데이터 학습을 하고, 오용·편향된 데이터를 학습에 활용하지 않아야 한다고 명시했다.

또 공공성 항목에서 이용자는 AI를 보조수단으로 인지하고, 운영자는 AI 도입 시 해당 서비스 관련 일자리에 미치는 영향을 고려야 한다는 점을 강조했다.

서울시 생성형 AI 윤리 가이드라인은 생성형 AI의 특성과 서울시 핵심가치를 기반으로 연구한 것이 특징이다.

민간기업에 대한 규제적 접근이 아닌 생성형 AI를 안전하게 활용할 수 있도록 자율 준수 규범을 제시한다. 가짜뉴스나 개인정보 침해 등 AI 확산의 부작용을 최소화하고 시민들이 일상에서 AI를 안전하게 활용할 수 있게 돕는 게 목적이다.

강요식 서울디지털재단 이사장은 “생성형 AI가 확산되는 가운데, 가짜뉴스, 개인정보 침해 등 AI 위험 우려도 커지는 상황으로 재단은 시민 안전을 위해 선제적으로 지자체 최초 생성형 AI 윤리 가이드라인을 발표하게 됐다”며 “시민들이 안전하고 편리하게 AI를 활용하기를 기대하며, 우리 재단도 시민교육, 윤리문화 확산 활동을 통해 건전한 AI 활용문화 조성을 위해 노력할 것”이라고 말했다.

김명희 기자 noprint@etnews.com