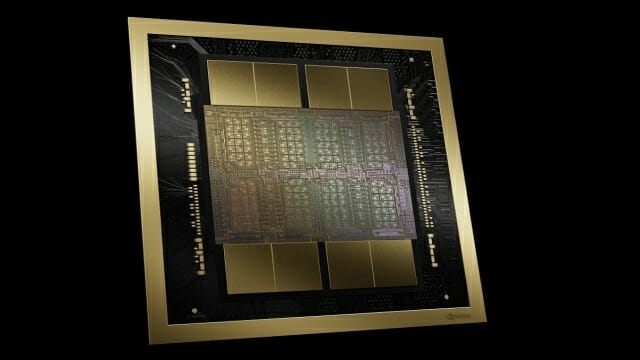

아마존웹서비스(AW)S가 엔비디아 최신 그래픽처리장치(GPU) '블랙웰'을 탑재한 'EC2 P6 B200인스턴스'를 내놨다. 인공지능(AI)과 고성능 컴퓨팅(HPC) 수요를 노린 것으로, 클라우드 기반 AI 컴퓨팅 시대를 여는 이정표라는 평가가 나온다.

AWS는 EC2 P6 인스턴스를 출시, 서비스를 시작했다.

맷 가먼 AWS CEO가 지난해 말 미국 라스베이거스에서 열린 'AWS 리인벤트 2024'에서 올해 EC2 P6 인스턴스를 출시하겠다고 밝힌 지 약 5개월 만이다.

P6-B200 인스턴스는 대규모 AI 모델 학습과 HPC 워크로드에 적합한 고성능 인프라를 제공한다.

엔비디아 블랙웰 GPU(B200) 8개로 1440GB HBM3e 고대역폭 메모리를 구성한다. CPU와 메모리는 5세대 인텔 제온 프로세서와 192 vCPU, 2TiB 시스템 메모리 사양을 갖췄다.

엔비디아 H100으로 구성된 이전 세대 'P5'와 비교해서 AI 학습과 추론 성능이 최대 2배 이상 향상됐다.

P6-B200 인스턴스는 대규모 AI 모델 학습과 실시간 추론이 필요한 엔터프라이즈 고객을 겨냥했다.

이를 위해 AWS는 저지연 고대역폭 네트워킹, EC2 울트라 클러스터, 아마존 세이지메이커, AWS 딥러닝 AMI 등 다양한 서비스와 통합해서 확장성과 보안성까지 높였다.

엔터프라이즈 고객은 AI 모델 학습과 추론 비용을 절감하면서도 안전하게 더욱 빠른 AI 모델을 개발하고, 배포하게 될 것으로 기대된다.

AWS는 B6-B200 인스턴스를 미국 서부에서만 우선적으로 제공할 방침이다. 다만 비교적 이른 시일 내에 아시아 태평양(서울) 등을 포함해서 다른 리전으로 서비스를 확장할 것으로 보인다.

AWS는 점차 서비스 대상 리전을 확대해 나가는 방식의 확장 전략을 펼치기 때문이다. 무엇보다 우리나라를 포함한 아시아 태평양 지역은 AI와 고성능 컴퓨팅 수요가 높다.

AWS 관계자는 “P6-B200 인스턴스를 다른 지역에 출시하는 시점과 계획 등은 확인해줄 수 없다”고 말했다.

류태웅 기자 bigheroryu@etnews.com