광주과학기술원(GIST)은 전해곤 인공지능(AI)대학원 교수팀이 2차원(D) 영상으로부터 다양한 동작이 가능한 고품질 3D 인물을 구현하는 기술을 개발했다고 25일 밝혔다.

단일 이미지에서 3D 인물을 생성하는 기존 방법론들은 정적인 아바타로 단순히 3D 공간에서 형태를 만드는 데 그치며 자유로운 움직임이 불가능하다는 한계를 지닌다. 정적 아바타를 실제로 움직이게 하려면 캐릭터에 가상의 뼈대와 관절을 설정해 각 부위가 자연스럽게 움직일 수 있도록 만드는 '리깅(rigging)'이라는 과정이 필수적이다. 리깅 과정은 매우 정교한 작업을 요구하며, 캐릭터의 움직임이 현실감 있게 표현되기 위해서는 숙련된 그래픽 디자이너들이 모든 관절과 움직임의 범위를 하나하나 수동으로 지정해야 한다.

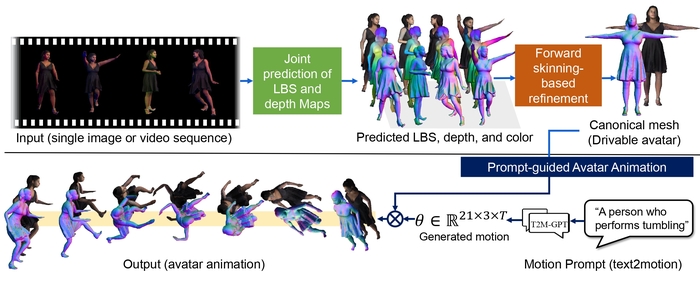

이번 연구의 핵심은 깊이 정보와 스키닝 맵을 동시에 예측한 뒤 이를 바탕으로 초기 다이내믹 아바타를 생성하고, 여러 이미지 정보를 통합 및 개선하는 것이다. 한 인물이 몇 가지 포즈를 취한 이미지만으로도 3D 인물 모델의 생성이 가능한 이 기술은 먼저 각 이미지에서 제1신경망을 통해 인물의 앞뒤 깊이 정보와 스키닝 맵을 예측한다. 높은 차원의 스키닝 맵을 간단히 표현하기 위해 오토 인코더 및 디코더로 구성돼 있는 제2신경망 모델을 사용해 복잡한 스키닝 정보를 압축하고, 다시 풀어내어 정확한 움직임을 구현한다.

그 다음 예측된 깊이 정보와 스키닝 맵을 바탕으로 초기 3D 아바타, 즉 캐노니컬 메시를 생성한다. 기존에는 인물 템플릿 모델을 활용해 구현된 모델에 대해 스키닝 값을 계산하고 캐노니컬 메시를 생성해야 했으나 연구팀이 개발한 기술을 이용하면 별도의 후처리 과정 없이도 캐노니컬 메시를 생성할 수 있다.

연구팀이 제안한 포워드 스키닝 기반의 렌더링 기법을 사용해 초기 아바타를 정교하게 다듬고, 텍스처를 입힌다. 이 기법은 여러 이미지의 정보를 통합해 컬러와 위치 차이를 2D 이미지 기반으로 줄여 가며 아바타의 정확도를 높일 수 있다. 생성된 아바타의 관절과 제1신경망을 통해 생성된 아바타의 포즈 차이를 줄여 포즈 오차가 크지 않다는 장점이 있다. 이러한 방식을 통해 자연스러운 움직임이 가능한 3D 아바타를 만들 수 있다.

이 기술은 입력 이미지의 수량에 제한을 받지 않으며, 단일 이미지로도 현실감 있는 결과물을 얻을 수 있다는 장점이 있다. 최근 주목받고 있는 초거대 언어 모델 기반의 텍스트로 움직임을 생성하는 기술과 결합해 아바타가 다양한 동작을 구현할 수 있다는 가능성을 보여준다.

전해곤 교수는 “이번 연구 성과를 통해 기존 그래픽 디자이너들이 3D 객체를 움직이는 데 소요되는 시간과 비용을 크게 절감할 수 있으며, 일반인들도 2D 이미지만으로 손쉽게 3D 아바타를 생성하고 활용할 수 있다”면서 “향후 인간이 수행하기 어려운 복잡한 동작을 요구하는 액션 영화 혹은 게임 등 다양한 문화산업에서 사실적인 아바타로서 활용될 것으로 기대한다”고 말했다.

광주=김한식 기자 hskim@etnews.com