“인공지능(AI)의 기능이 발전할수록 안전성도 함께 개선돼야 합니다.”

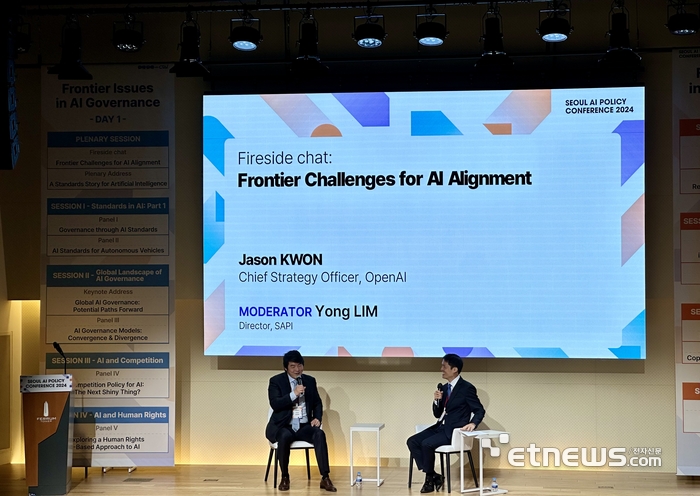

제이슨 권 오픈AI 최고전략책임자(CSO)는 12일 서울 을지로 페럼타워에서 열린 'AI 거버넌스의 프런티어 이슈' 콘퍼런스에서 AI 기능 발전과 안전성에 대한 질문에 이같이 답했다.

AI 기술이 발전할수록 안전성에 대한 검사 기능이 필요하며, 이를 검증하는 과정도 중요하다는 것이다. 챗GPT에 부적절한 질문을 했을 경우 대답하지 않는 것이 대표적이다.

제이슨 권은 챗GPT를 개발·운영하는 오픈AI의 최고전략 임원으로서 정책, 법률, 사회적 영향 연구 팀을 총괄하고 있다. 샘 올트먼 오픈AI 창업자가 창업 전 와이 콤비네이터 대표로 재직할 당시 법무 최고 책임자로 인연을 맺었다.

그는 AI 안전과 함께 '얼라인먼트(Alignment)' 관련 윤리적 규범이 필요하다고 강조했다.

AI 분야에서 얼라인먼트란 AI 시스템의 행동과 결정이 인간의 가치와 목표에 부합하도록 만드는 것을 의미한다. AI가 사람들의 의도와 기대를 이해하고 그에 맞게 작동하도록 만드는 것이 핵심이다.

제이슨 권은 “AI 얼라인먼트에는 강건한 윤리적 규범이 필요하다”며 “이는 기업 거버넌스(기업구조)와 밀접하게 연결된다”고 전했다.

그는 “어떤 시스템이든 사람이 중요하다”며 “이 기술을 어떻게 통제하고 관리할 것인지도 결국 사람이 의사결정을 한다”며 기업 거버넌스도 발전, 진화하고 있다고 강조했다. 비영리단체로 출발한 오픈AI가 대규모 자본 유치를 통해 컴퓨터 자원을 확보하고, 이를 소화하기 위해 사업화의 길을 걷게 된 것을 기업구조 진화의 예시로 들었다.

제이스 권은 “AI 안전성은 인간이 원하는 방향으로 AI가 행동하도록 하는 것”이라며 “결국 인간 사회가 AI를 관리하고 통제할 수 있도록 하는 것이 핵심”이라고 설명했다.

마지막으로 제이슨 권은 AI 안전성 문제 해결을 위해 미국과 영국의 AI 안전성 기관 등 다양한 정부, 학계, 미디어 등과 협력하고 있다고 밝혔다.

또 한국에서 챗GPT를 적극 활용하는 사람은 100만명이 못 되고, 미국에서도 20% 미만인 점을 들면서 AI는 아직 초기 시장이고 더 많은 AI 활용사례(유스케이스)가 필요하다고 덧붙였다.

'AI 거버넌스의 프런티어 이슈' 콘퍼런스는 서울대인공지능정책이니셔티브(SAPI)와 서울대인공지능신뢰성센터(CTAI)가 공동으로 주최, 12·13일 양일간 진행된다. 글로벌 AI 거버넌스의 핵심 과제로 부성하고 있는 AI 표준 정립, AI 거버넌스 모델, 프라이버시, 저작권, 가짜정보, 인권 및 경쟁 등 AI 거버넌스의 주요 현안을 다룬다.

김명희 기자 noprint@etnews.com