한국과학기술원(KAIST) 연구진이 뎁스(깊이) 정보까지 얻을 수 있는 전방향 360도 카메라를 개발했다. 지금까지 360도 카메라와 뎁스 카메라를 일체화한 시스템은 없었다. 개발 기술은 자율주행 모빌리티 분야에서 각광 받을 것으로 전망된다. 김민혁 KAIST 전산학부 교수팀(비주얼 컴퓨팅 랩)이 관련 하드웨어(HW)와 소프트웨어(SW) 기술을 개발했다.

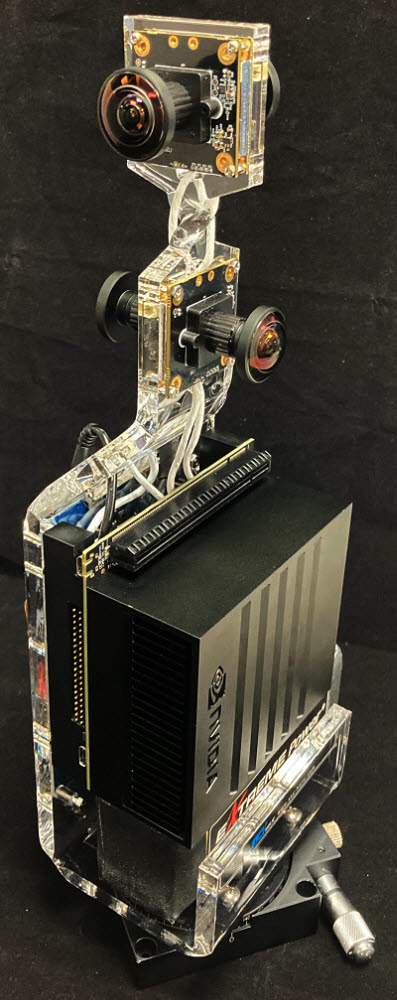

HW는 기존 어안렌즈를 활용했다. 어안렌즈는 화각이 200도 정도인 카메라로, 마치 물고기가 보는 듯한 왜곡 영상을 얻을 수 있다. 통상 이런 어안렌즈를 2~4개 사용해서 360도 카메라를 구성한다. 다만 기존에는 360도 카메라로는 뎁스 정보를 얻을 수 없었다. 별도로 일반 카메라 두 대를 활용, 양안 시차로 뎁스 정보를 얻었다.

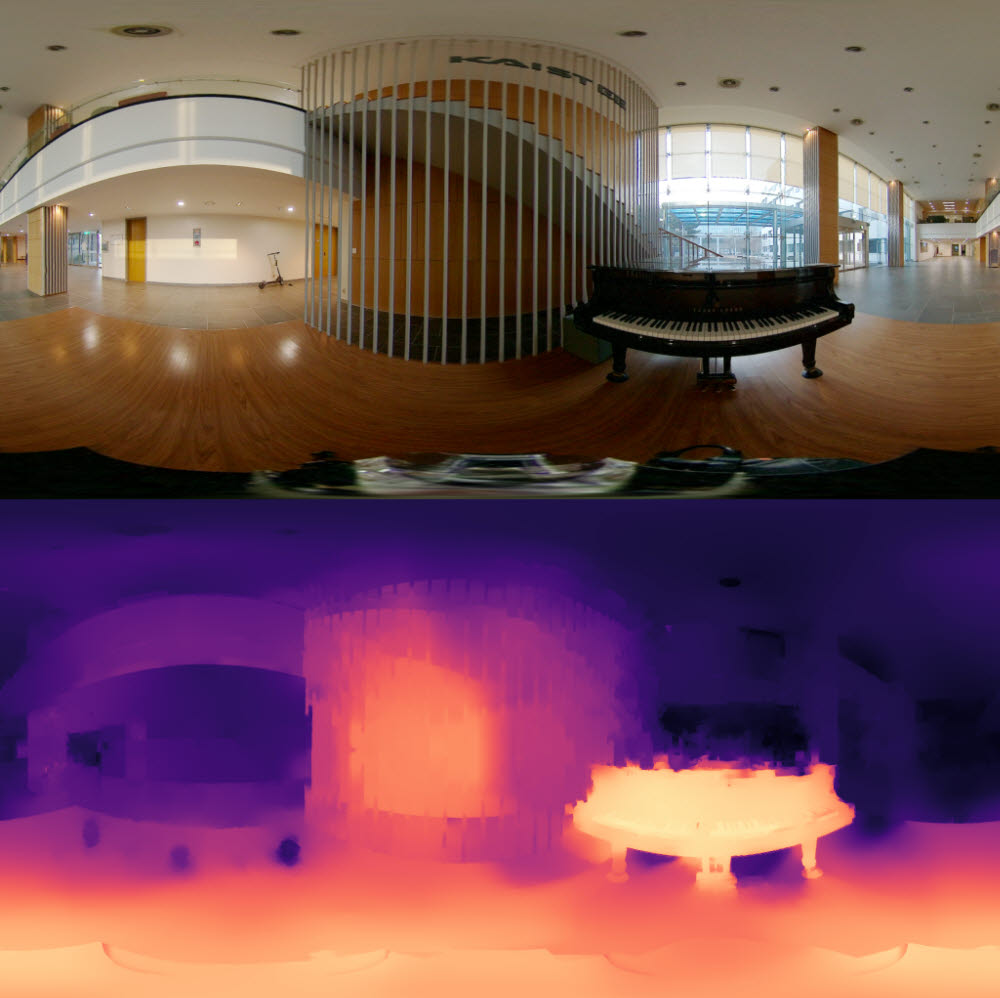

연구팀은 360도 카메라에서도 양안 시차를 활용할 수 있게 했다. 어안렌즈 카메라로 얻은 영상 속에 겹치는 부분(오버랩)에 주목했다. 다만 어안렌즈로 얻은 영상은 왜곡이 커서 뎁스 정보 추출이 어렵다는 문제가 있다. 불가능한 일은 아니지만 실시간 처리가 안 됐다. 빠른 반응이 필수인 자율주행 모빌리티에 쓸 수 없었다. 연구진은 어안렌즈 카메라의 영상 왜곡 현상을 해결하고 프레임별 360도 '뎁스맵'을 도출하는 알고리즘으로 문제를 해결했다.

정보를 실시간으로 얻는다는 것이 큰 특징이다. 오버랩 부분에 존재하는 뎁스 정보를 영상 전 영역으로 확장하는 고속화 기술을 알고리즘에 적용한 덕분이다. 차량에 설치 가능한 소형 임베디드 컴퓨터를 써도 초당 30프레임 영상 획득이 가능하다. 지연 시간은 0.28밀리세컨드(ms) 수준이다. 연구진은 이 기술과 관련해 국내 특허를 출원했고, 미국을 비롯한 해외 3개국 특허 출원을 준비하고 있다. 김민혁 교수는 “360도 카메라로는 뎁스 정보를 얻을 수 없다는 고정관념을 깨고 얻은 성과”라며 “향후 자율주행 업계에서 큰 반향이 있을 것으로 보고 있다”고 말했다.

관련 연구는 컴퓨터비전 최고 학회인 CVPR 2021에서 소개됐다.

김영준기자 kyj85@etnews.com