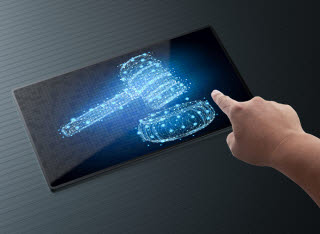

B1-66ER는 집안일을 하는 인공지능(AI) 로봇이다. 느려 터져서 쓸모없다고 버리려 하자 로봇폐기업자의 입 안으로 변기솔을 쑤셔 넣고, 주인마저 얼굴을 뜯어내는 등 잔인하게 죽인다. 최초로 인간을 살해한 로봇이 돼 법정에 선다. 판사가 살해한 이유를 물으니 “그저 살고 싶었다”고 답한다. 놀라지 마라. '애니메이션 매트릭스'(Animatrix)에 나오는 최초의 깨달음을 얻은 로봇 이야기다. 로봇 B1-66ER의 이름은 최초의 흑인 해방 소설인 네이티브 선(Native Son) 등장인물인 Bigger에서 착안했다고 한다. 이 대목에서 AI의 공격을 받아 다친 사람은 누구에게 어떤 배상책임을 물을 수 있는지 궁금해진다.

민법상 불법행위(不法行爲)를 한 자에게 손해배상을 요구하려면 가해자에게 고의 또는 과실이 있어야 한다. 가해행위(加害行爲)가 위법해야 하고, 가해행위로 인해 손해가 발생해야 한다. 사람이 아닌 AI는 법적 의무가 없기 때문에 손해배상책임도 없다. AI의 작동에 관여한 사람(자연인 또는 법인)에게 손해배상을 청구할 수 있는지가 관건이다.

첫째 고의 또는 과실을 인정할 수 있는지 보자. AI는 사람이 만든 알고리즘에 의해 작동되는 것에 불과하기 때문에 AI의 고의 또는 과실 인정은 법적 의미가 없다.

AI에 데이터를 투입하거나 AI 알고리즘을 작동시키는 등 AI를 통해 특정 작업을 한 사람의 고의 또는 과실은 인정할 수 있다. AI 작동을 통해 사람에게 피해를 주려 했거나 피해가 있을 수 있다는 것을 알면서도 주의 의무를 소홀히 했다면 고의 또는 과실을 인정해야 한다.

둘째 가해행위는 사람의 의식적 행위여야 하기 때문에 사람이 아닌 AI의 행위는 법적 가해행위가 될 수 없다. 그러나 AI를 작동시킨 사람의 행위는 가해행위가 될 수 있다.

이 경우 AI의 딥러닝 등 자기 학습을 통해 일어난 가해를 AI를 작동시킨 사람의 가해행위로 볼 수 있는지가 문제 된다. 사람이 정상적으로 AI를 작동시켰는데 AI가 스스로 학습함에 따라 사람의 예측과 달리 가해한 경우가 있을 수 있기 때문이다.

셋째 AI를 작동시킨 행위와 피해자에게 발생한 손해 사이에 인과관계가 있어야 한다. 그러나 AI 알고리즘의 자기 학습이 중간에 개입됨에 따라 법적으로 책임을 묻기 위한 요건으로서의 인과관계를 인정하기가 어려울 수 있다. 여기서 피해자의 입증 책임을 완화하거나 반대로 AI를 작동시킨 자가 입증 책임을 지도록 할 필요성이 제기된다.

한편 민법 이외에 제조물책임법에 따라 손해배상을 요구하는 방법도 있다. AI 알고리즘이 탑재된 하드웨어(HW), 장치 등 물건은 제조물이기 때문에 제조물책임법을 적용해 제조·설계·표시상의 결함을 이유로 손해배상을 받을 수 있다. 그러나 AI 알고리즘의 정상 작동으로 손해가 발생했다면 제조물의 결함이 없기 때문에 배상이 어려울 수 있다.

배상 방법은 금전 배상이 원칙이다. 그 밖에 피해자의 청구에 의해 AI 폐기, 매각 등 적당한 처분을 가해자에게 하게 할지 논의가 필요하다.

손해배상법의 대원칙인 과실책임주의의 예외를 인정해 AI 불법행위에 대해 무과실책임을 인정해야 한다는 의견도 있다. 민법상 공작물 소유자책임, 자동차손해배상보장법상 보유자책임과 같이 입법을 통해 AI를 작동시킨 자의 책임을 인정하자는 논의도 있다. 그러나 AI 기업이 AI 활용으로 이익을 얻었다거나 AI의 작동 과정이나 위험 영역을 지배하고 있다는 이유만으로 무과실책임 등 책임을 가중하는 것은 초기 AI 산업 발전 등을 고려할 때 시기상조라는 견해가 많다.

우선 관계 법령에서 AI 업체에 기술적·관리적·물리적 안전조치 의무를 부여하고 그 위반으로 손해가 발생한 경우 배상책임을 인정하는 것부터 시작하면 어떨까. 보험제도의 활용도 필요하다. AI 발전은 안전을 전제해야 달성되는 과제임을 잊지 말자.

이상직 법무법인 태평양 변호사(국가지식재산위원) sangjik.lee@bkl.co.kr