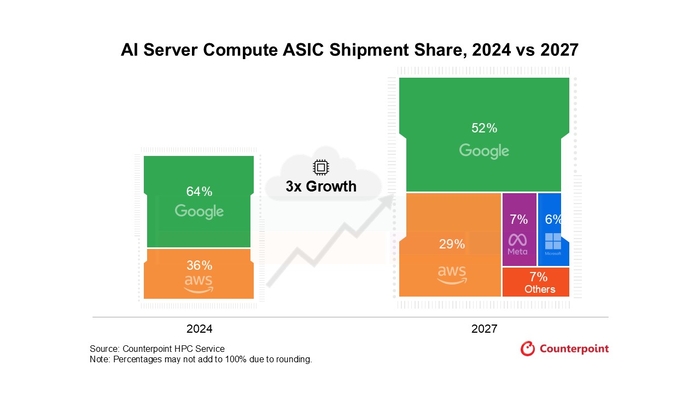

관련 통계자료 다운로드 AI 서버 컴퓨팅 ASIC 점유율

관련 통계자료 다운로드 AI 서버 컴퓨팅 ASIC 점유율 세계 인공지능(AI) 서버용 주문형 반도체(ASIC) 시장이 하이퍼스케일러(대규모 클라우드 서비스를 보유한 빅테크)의 '자체 칩' 확대에 힘입어 급성장할 것이라는 전망이 나왔다.

28일 시장조사업체 카운터포인트리서치에 따르면 구글, 아마존웹서비스(AWS), 마이크로소프트, 오픈AI, 애플 등 클라우드·AI 제공업체들이 출하하는 AI 서버 컴퓨팅 ASIC 물량은 2024년 대비 2027년까지 3년 새 3배로 늘어날 것으로 관측된다.

이 같은 성장세는 제미나이 지원을 위한 구글 TPU 인프라 수요 확대, AWS 트레이니엄(Trainium) 클러스터의 지속 확장, 메타(MTIA)와 마이크로소프트(Maia)의 내부 실리콘 램프업이 맞물린 결과로 풀이된다. 해당 기업들은 특수 AI 학습 및 추론 워크로드를 위해 AI 서버 컴퓨팅 ASIC 기반 서버 배치를 가속화하고 있다.

닐샤 카운터포인트 리서치 부문 부사장은 “자체 AI 서버 컴퓨팅 ASIC 설계 확대 움직임은 '커스텀 XPU 시대'가 유효하다는 점을 보여준다”며 “학습·추론 등 특정 워크로드에 맞춘 AI 가속기가 늘어나면서 범용 GPU 중심 구조가 다변화되고 있다”고 분석했다.

향후 출하량 역전 가능성도 제기됐다. 카운터포인트리서치는 데이터센터용 AI 서버 컴퓨팅 ASIC 출하량이 2028년 1500만개를 넘어 데이터센터 GPU 출하량을 웃돌 것으로 추정했다. 상위 10대 AI 하이퍼스케일러가 2024~2028년 누적으로 배포하는 AI 서버 컴퓨팅 ASIC 칩은 4000만 개를 넘길 것이라는 전망이다.

시장 구조도 재편될 것으로 보인다. AI 서버 컴퓨팅 ASIC 시장은 2024년 구글(64%)과 AWS(36%)가 사실상 양분하는 복점 구조였으나, 2027년에는 메타(MTIA)와 마이크로소프트(Maia)의 물량 확대가 본격화되며 출하가 분화되는 방향으로 전환될 전망이다.

이는 초대형 클라우드 사업자들이 엔비디아 등 범용 실리콘에 대한 의존도를 낮추고, 워크로드별 성능·전력 효율을 최적화하기 위해 내부 커스텀 실리콘 전략을 업계 전반으로 확산시키고 있음을 시사한다.

설계 파트너 경쟁도 한층 달아올랐다. 카운터포인트리서치는 브로드컴이 2027년에도 AI 서버 컴퓨팅 ASIC 설계 파트너로서 60% 점유율을 유지하며 선두를 지킬 것으로 내다봤다. 다만 구글이 미디어텍과 협력 관계를 강화하면서 경쟁 강도는 높아질 것으로 관측된다.

특히 구글이 차세대 TPU v8 시리즈에서 듀얼 소싱 전략을 택해 학습용 고성능 칩은 브로드컴, 추론 중심 칩은 미디어텍이 파트너로 거론되며 공급망 다변화가 본격화되는 흐름이다.

박유민 기자 newmin@etnews.com